一、Simulink模型简述

该模型对简化的汽车运动进行仿真。当踩下踏板时,汽车通常处于行进状态。轻踩并松开加速踏板后,汽车先会处于怠速状态,然后停止。基于上述运动模型再对接近传感器建模,该数字传感器用于测量汽车与10米(30英尺)外的障碍物之间的距离。模型根据下列条件来输出传感器的测量值和汽车的位置值:

●汽车在到达障碍物时会紧急刹车。

●在现实世界中,传感器对距离的测量不够精确,从而导致随机数值误差。

●数字传感器以固定时间间隔运行。

二、构建模型

Step 1. 创建新模型

1.要启动Simulink并创建新模型,请在MATLAB命令提示符下输入以下内容:

simulink

在Simulink Start Page对话框中,点击Blank Model,然后点击Create Model,将打开一个空的Editor 窗口。

2.在Editor工具条的Simulation选项卡上,点击Save > Save As为新模型指定名称。

Step 2. 拖放模块以完成模型

在该模型中需要针对以下每个模块创建一个实例:

●Pulse Generator

该模块的作用是为模型生成脉冲信号,模拟轻踩加速踏板后的输出信号。

●Gain

该模块的作用是将输入信号乘以一个因子,计算踩下加速踏板后如何影响汽车的加速度。

●Integrator, Second Order

该模块的作用是对输入信号进行二次积分,根据加速度计算得到汽车的位置。

●Out1

该模型的作用是将汽车位置作为模型的输出。

Step 3. 配置模块

通过双击模型中的每个模块为模块设置参数。

配置Pulse Generator模块。双击Pulse Generator模块以打开其参数对话框。验证或设置以下参数:

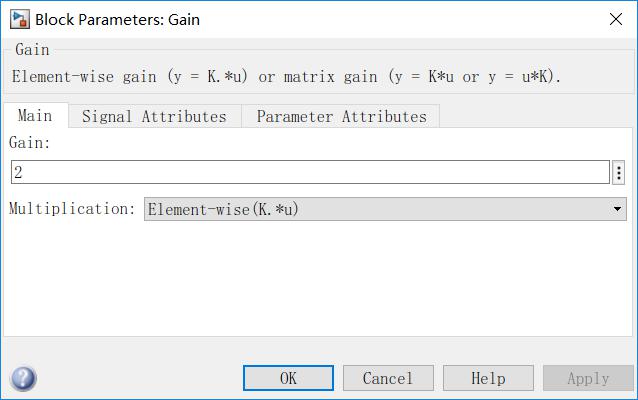

配置Gain模块。双击Gain模块以打开其参数对话框。验证或设置以下参数:

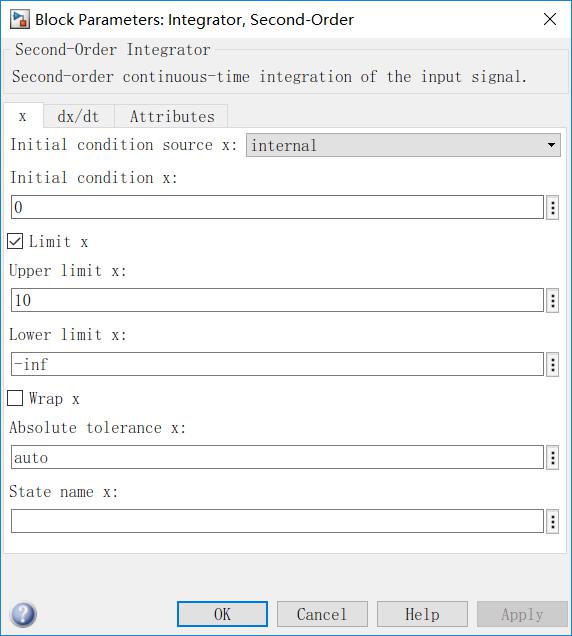

配置Integrator, Second Order模块。双击Integrator, Second Order模块以打开其参数对话框。

在x选项卡上,进行如下设置(其余选项卡按照默认设置):

Step 4. 连接模块并为信号添加注释

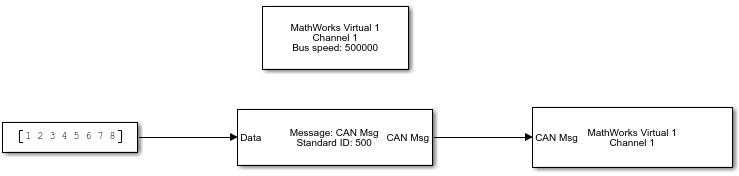

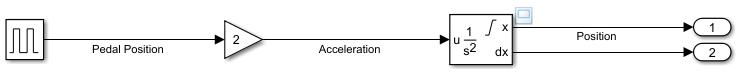

构建完成的模型如下图所示:

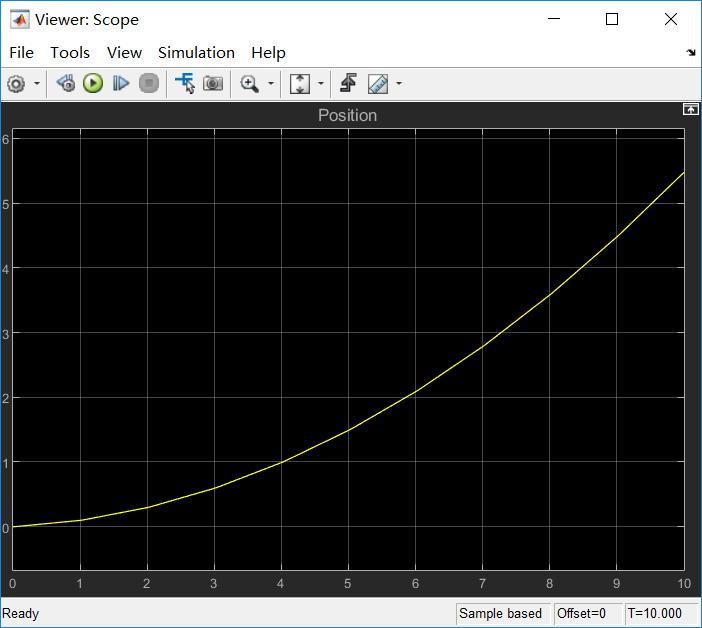

Step 5. 添加信号查看器

要查看仿真结果,请将第一个输出连接到一个Signal Viewer。

通过右键点击信号来访问上下文菜单。选择Create & Connect Viewer > Simulink > Scope。信号上会出现查看器图标,并打开一个示波器窗口。

Step 6. 运行仿真

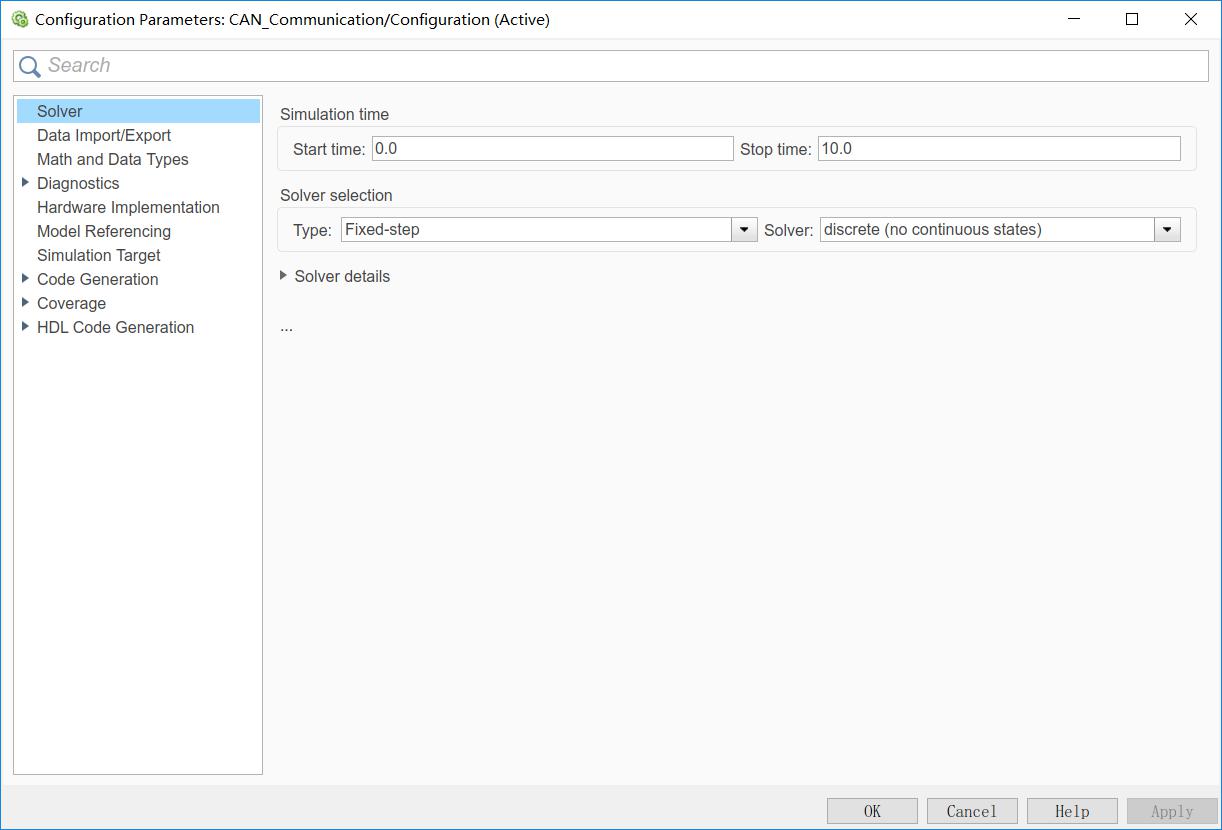

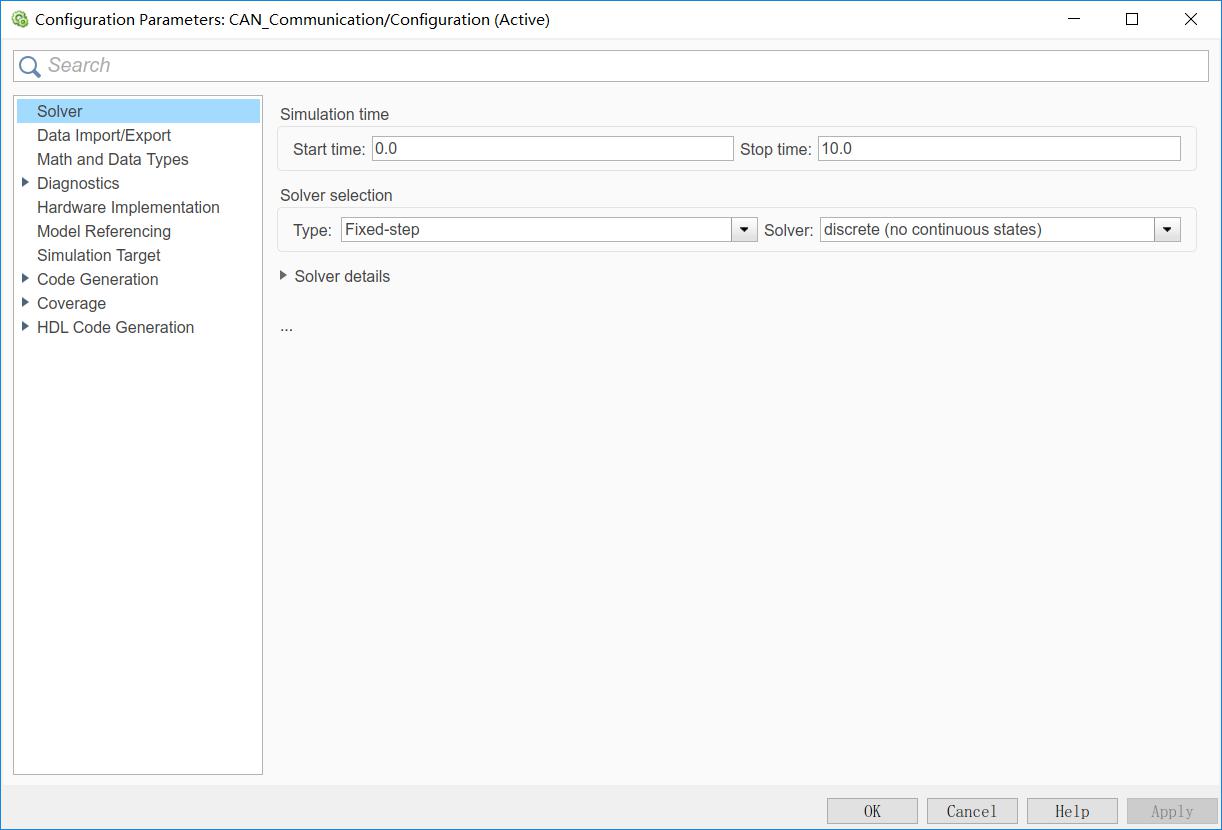

1.在模型Editor工具条的Modeling选项卡中,点击Model Settings。将打开Configuration Parameters对话框。

在Solver Options部分中,进行如下选择:

2.点击Editor工具条的Simulation或Modeling选项卡中的Run按钮,运行仿真。

三、优化模型

Step 7. 拖放新模块以完成模型

●Constant

该模块的作用是为障碍物的位置设置常量值10。

●Subtract

该模块的作用是将两个输入值相减,求出障碍物位置和车辆位置之间的实际距离。

●Band-Limited White Noise

该模块的作用是产生白噪声,模拟真实传感器测量中常见的误差。

●Add

该模块的作用是将两个输入值相加,从而将白噪声添加进数字传感器采样数据中。

●Zero-Order Hold

该模块的作用是让采集的信号样本数据保持一定时间间隔,模拟离散系统对数字传感器采样。

Step 8. 配置新模块

通过双击模型中的每个模块为模块设置参数。

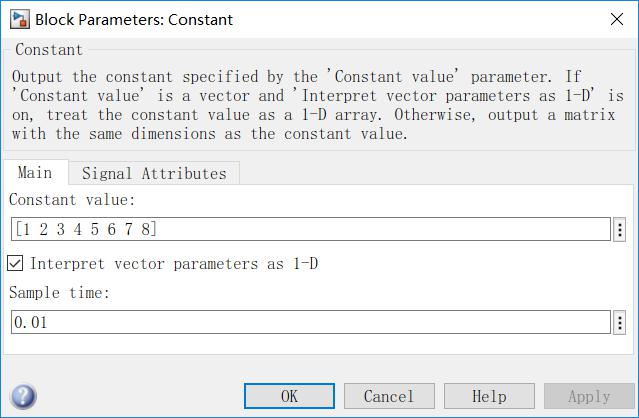

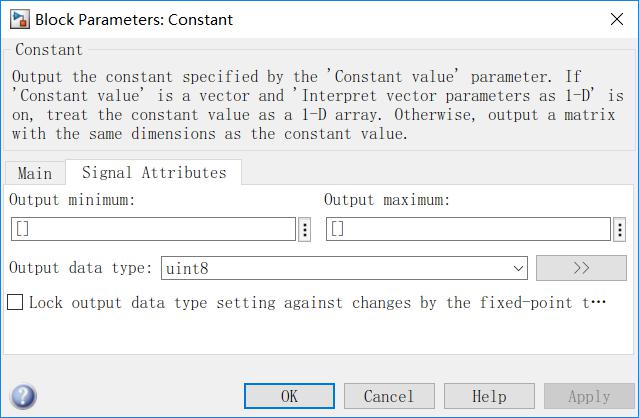

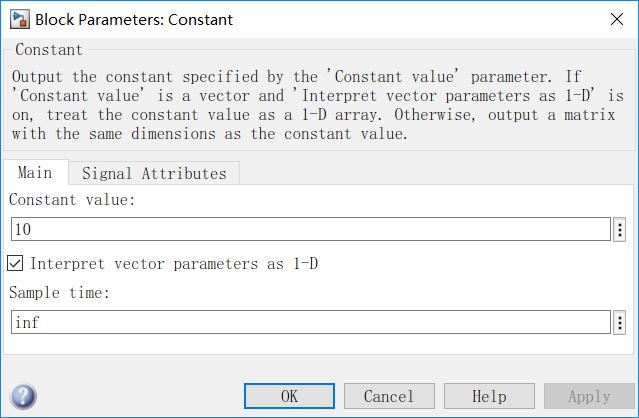

配置Constant模块。双击Constant模块以打开其参数对话框。验证或设置以下参数:

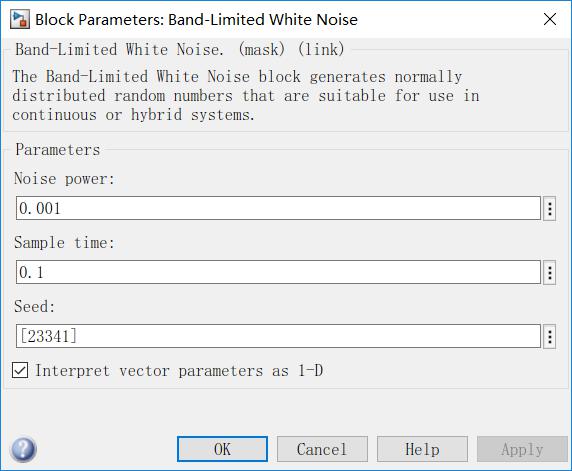

配置Band-Limited White Noise模块。双击Band-Limited White Noise模块以打开其参数对话框。验证或设置以下参数:

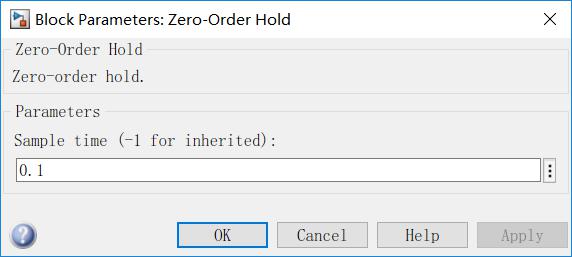

配置Zero-Order Hold模块。双击Zero-Order Hold模块以打开其参数对话框。验证或设置以下参数:

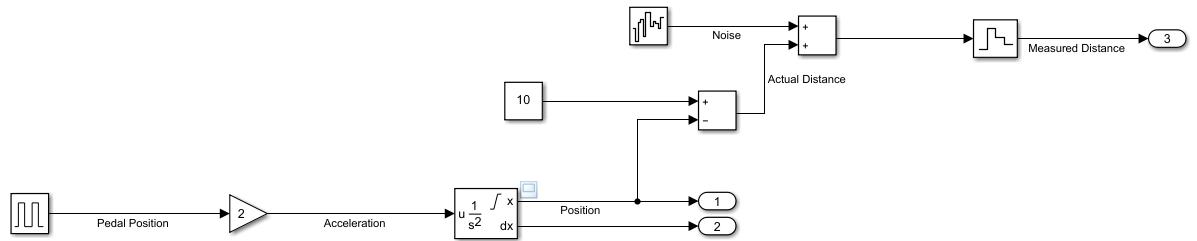

Step 9. 连接模块并为信号添加注释

构建完成的模型如下图所示:

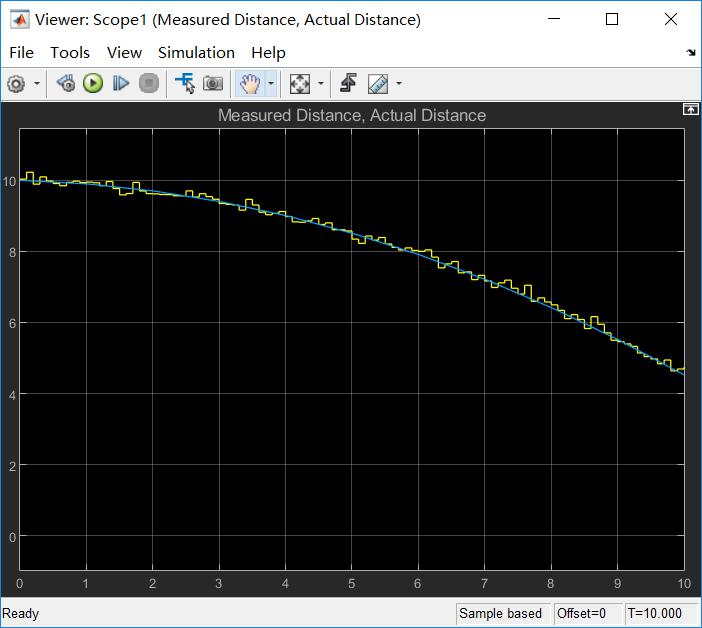

Step 10. 比较多个信号

将actual distance信号与measured distance信号进行比较。

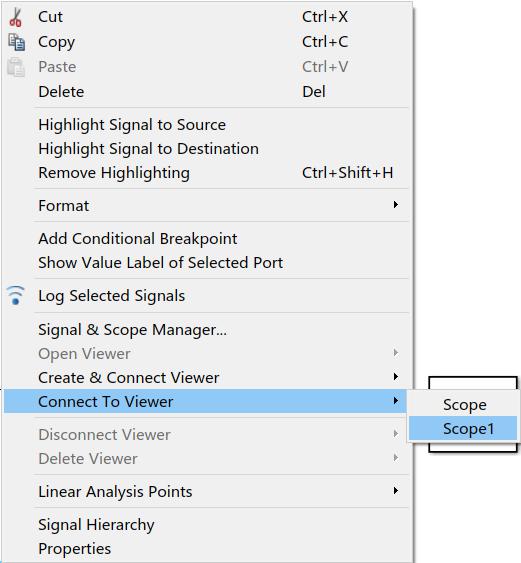

1.创建一个示波器Scope1并将其连接到actual distance信号。

2.将measured distance信号添加到同一个查看器中。右键点击信号,然后选择Connect to Viewer > Scope1。确保连接到在上一步中创建的查看器。

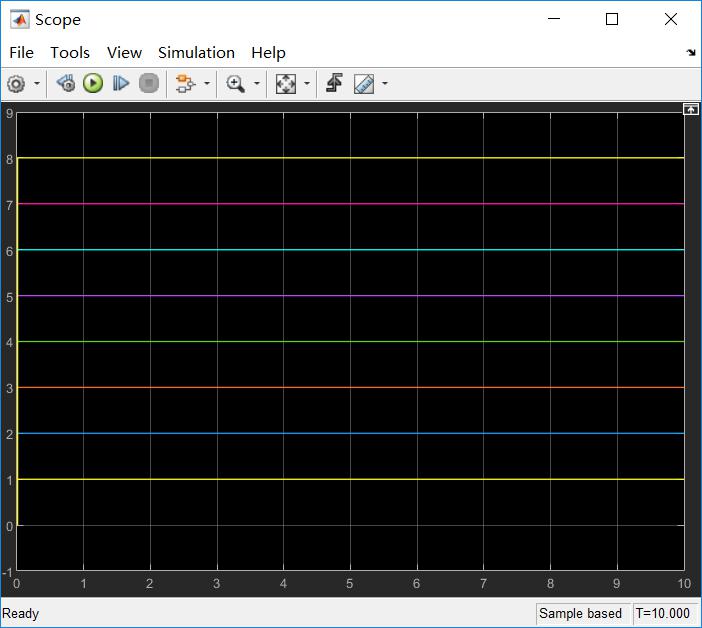

Step 11. 运行仿真

查看器显示两个信号:Actual Distance(黄色)和Measured Distance(蓝色)。